ภาพการแข่งขันในหมู่ยักษ์ใหญ่ AI ยังขยับต่อเนื่อง เทรนด์หลักๆ ที่เราเห็นคือยักษ์ใหญ่ในวงการ AI เหมือนกำลังพยายาม “Go Full Stack” หรือก็คือพยายามเป็นเจ้าของตั้งแต่ระดับชิพ ไปจนถึงแอป ถ้าทำตรงไหนเองไม่ได้ก็จะร่วมมือกันแบบแน่นแฟ้นขึ้น

ในสัปดาห์ที่ผ่านมาเราเห็น Amazon ขยายความร่วมมือกับ Anthropic ครั้งนี้ไม่ใช่แค่เข้าลงทุน หรือเป็น preferred partner แต่จะทำงานร่วมกันตั้งแต่ดีไซน์ชิพ Trainium 2 ที่เหมาะกับโมเดลของ Anthropic เลย

Trainium2 lags Nvidia’s systems in many ways, but it was pivotal to the multi-gigawatt AWS/Anthropic deal. Its memory bandwidth per TCO advantage perfectly fits into Anthropic’s aggressive Reinforcement Learning roadmap. Dario Amodei’s startup was heavily involved in the design process, and its influence on the Trainium roadmap only grows from here.

Put plainly: Trainium2 is converging toward an Anthropic custom-silicon program. This will enable Anthropic to be, alongside Google DeepMind, the only AI labs benefiting from tight hardware–software co-design in the near horizon.

ยูทูปช่องลงทุน Diary สรุปข่าวนี้ได้ดีเลยครับ

แต่สำหรับมูฟนี้ เป็นเหมือนการตีตื้นก่อนโดน OpenAI ทิ้งห่างมากกว่า เพราะทางฝั่งพี่ Sam เองก็ไม่รีรอ เราเห็น OpenAI ก็กำลังเริ่มดีไซน์ชิพของตัวเองกับ Broadcom และซื้อ Capacity จาก Oracle ในโปรเจ็ค Stargate รอไว้แล้ว

นอกจากนั้นก็มีผู้เล่นเดิมอย่าง Google และ xAI (อย่าลืมลูกพี่อีลอน) ที่ Full Stack อยู่แล้ว กำลังแย่งชิงบัลลังก์ Consumer AI จาก ChatGPT กลับมา

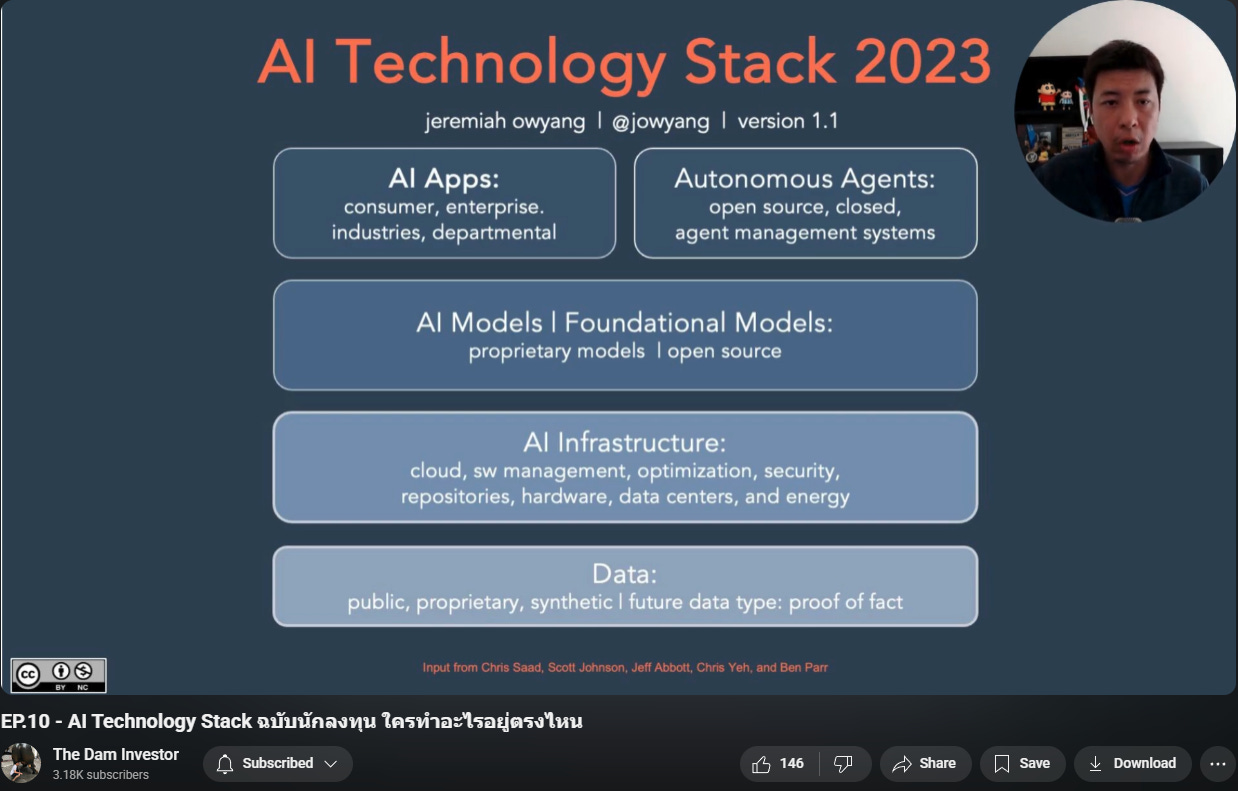

คำถามคือทำไมทุกคนกำลังมุ่งหน้าไปทาง Full Stack?

ข้อดีและข้อเสียของการร่วมมือกันเป็น Full Stack

สำหรับ Hyperscaler ที่ทำชิพของตัวเอง ผมคิดข้อเสียได้สองเรื่อง

ลดการพึ่งพา nVidia กำหนดชะตาชีวิตตัวเอง ทุกวันนี้ nVidia ที่มีกำลังการผลิตไม่พอ (และน่าจะไม่พอไปอีกยาว) เป็นผู้เลือกว่าจะจัดสรร GPU ให้ใครก่อน จำนวนเท่าไหร่ แน่นอนว่า Big Tech คงไม่ฝากชีวิตคลาวด์ของตัวเองไว้กับการตัดสินใจของ Jensen แต่ในทางกลับกัน ยิ่งพยายามทำเอง Jensen ก็ยิ่งไม่ชอบ และยิ่งขายให้น้อยไปด้วย (แบบ Amazon)

ลดต้นทุน: นี่ไม่ใช่ครั้งแรกที่เจ้าใหญ่ลงมาเล่นระดับชิพ เราเห็น Amazon ทำชิพ CPU ของตัวเองชื่อ Graviton ตั้งแต่ปี 2018 หลังจากนั้นก็ออกชิพอื่นๆ ตามมาเรื่อยๆ บิ๊กเทคเจ้าอื่นก็ออกมาเช่นกัน อย่าง Google ก็ออก TPU ที่เหมาะกับ AI workload พอดี การมีชิพที่ Specialize สำหรับ Infra และ Workload ของตัวเองก็จะช่วยลดต้นทุนที่สามารถส่งต่อไปให้ลูกค้าได้ในที่สุด

ทั้งนี้ Strategy นี้อาจจะไม่เวิร์คกับ GPU ตามที่ผมได้ขยายความในโพสต์ Amazon Valuation ที่มีความซับซ้อนกว่า ปรับตัวเร็วกว่า และมีคู่แข่งที่เก่งกว่าอย่า nVidia ที่ปรับการออกชิพรุ่นใหม่ทุก 1 ปีแทน 2 ปี ครั้งนี้มันไม่ใช่แค่ปรับชิพอันเดียวอีกต่อไป อาจกลายเป็นว่าทำยังไงก็ทำต้นทุนของการ inference ได้ไม่ถูกเท่า (ไม่ว่าจะเป็นกรณีที่ใช้งานหนัก หรือเบา)

โดยรวม สำหรับเหล่า Hyperscalers แล้วผมมองว่ามันเป็น Trade off ที่ดูแล้วถึงแม้จะทำแล้วแพ้ ก็ดีกว่าไม่ทำ

สำหรับผู้ทำโมเดลอย่าง Anthropic และ OpenAI การจับมือจะเพิ่มความสามารถในการแข่งขันของโมเดลตัวเอง ทั้งด้านต้นทุน และความสามารถ ซึ่งก็จะทำให้แอปที่ใช้โมเดลนั้นๆ แข่งขันได้ดีขึ้น แม้แต่ผู้เล่นอย่าง OpenAI ที่มีลูกค้าในมืออยู่แล้วก็ยังต้องทำเพื่อวิ่งหนีเพื่อให้ ChatGPT ยังดีกว่าคู่แข่งต่อเนื่อง แต่รายนี้มีเงินทุนเยอะพอที่จะทำชิพของตัวเอง

แต่ข้อควรระวังคือการผูกชีวิตตัวเองไว้กับ Cloud นั้นๆ มากขึ้นก็อาจทำให้ Flexibility น้อยลงเช่นกัน

แล้วเจ้าที่เหลือที่ยังไม่ Full Stack ล่ะ?

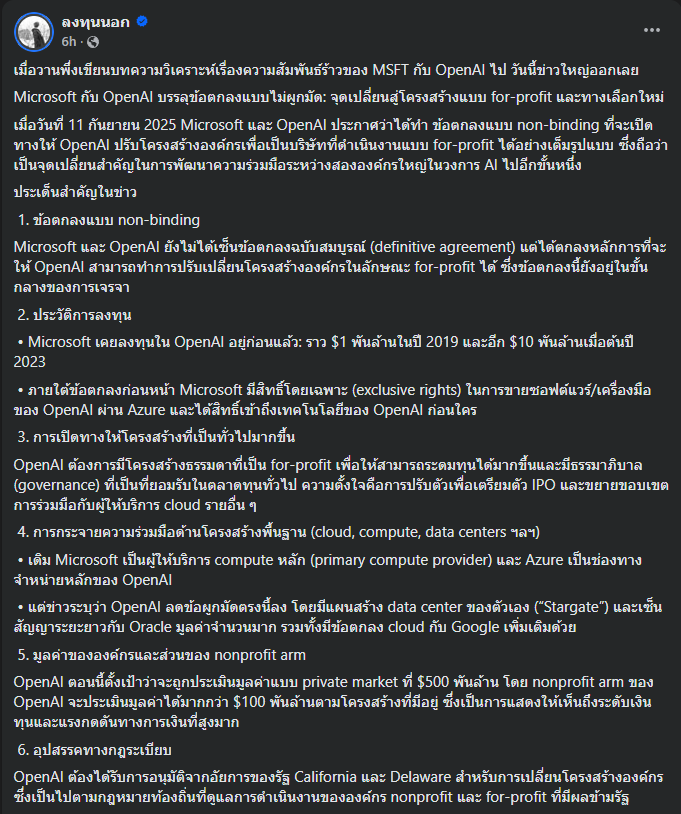

Microsoft:

ข่าวล่าสุด สรุปโดยพี่โรจน์ ลงทุนนอก

Microsoft ที่เคยมีสิทธิ์ใช้โมเดลตัวท็อปของ OpenAI ก่อนใคร ต่อไปเหมือนจะไม่มีสิทธิ์นี้แล้ว ซึ่งถ้าเป็นแบบนี้ ต่อไป Microsoft จะไม่มีโมเดล Frontier ที่ Optimize กับคลาวด์ของตัวเองโดยเฉพาะ แบบ AWS+Antrhopic / xAI + Grok / Google+Gemini

ตรงนี้น่าจะไม่ใช่ข่าวดีกับ Microsoft ในสายตาผม แต่หลังจากข่าวเรื่องดีลนี้ออก ราคาหุ้นขึ้น 1% After hour อาจจะเป็นเรื่องที่ข่าว Priced in ไปหมดแ้ลว อย่างไรก็ตาม Microsoft ก็ยังคงเป็นผู้โฮสต์หลักของ OpenAI (เขาก็มีการ Optimize ชิพตัวเองกับ Open AI เยอะอยู่) นอกจากนี้ยังสามารถเอา AI ไปทำเงินให้กับ Software ต่างๆ ของเขาได้อีกเยอะ และไม่แน่ โมเดล MAI-1 ของเขาอาจกลับมาตามผู้นำทันก็ได้

มีอีกสองผู้เล่นที่เหมือนจะ “ไม่เอา” แล้วในการสร้าง Frontier Model ก็คือ..

Meta

LLAMA ของ Meta ที่เคยมาแรงช่วงแรกๆ ตอนนี้ดรอปไปมาก และเหมือนจะไม่กลับมาแล้ว ล่าสุดเราเห็นข่าวว่า ทีม Super Intelligence Labs ได้คุยกับทีม Gemini ว่าจะเอา Gemini เข้าไปใช้ในแอปของ Meta ระหว่างที่บริษัทกำลังสร้างทีมเพื่อไล่ตามในยุค AI นี้

AI ของ Meta ส่วนใหญ่แล้วถูกเอาไปใช้ใน R&D และ Ecosystem ของตัวเองเพื่อเพิ่ม Engagement และ Monetization ของแอปที่เราเล่นกัน ซึ่งตรงนี้บริษัทยังทำได้ดีต่อเนื่อง

โอกาสใหม่ของ Meta น่าจะมาจากอะไรที่ต่อยอดมาจาก LLM อีกที อาจจะเป็นอะไรที่ร่วมกับอุปกรณ์ใหม่อย่างแว่น Meta Rayban เป็นต้น แต่เอาจริงผมไม่ได้หวังเยอะกับตรงนี้

Meta เหมือนจะเป็นผู้ใช้ประโยชน์จาก LLM มากกว่าผู้สร้าง เอามาต่อยอดบริการของเขาอยู่แล้วให้ดีกว่าเดิม ถ้าใครห่วงเรื่อง AI Bubble สร้างเกิน Capacity เมต้าเป็นตัวนึงที่ห่วงน้อยหน่อยเพราะเขามา Demand ของตัวเอง

Apple

หลังจากเคส Anti-trust ของ Google ผ่านแล้ว ก็ได้ยินข่าวลือกันว่า Apple จะเอา Gemini เข้ามาใน iPhone เหมือนกัน จะไปทำโมเดลให้ยุ่งเปลืองเงินทำไมใช้ของ Google ไปเลยสิ.. แล้วก็ใช้ข้อมูลลูกค้าที่อยู่ในเครื่องอยู่แล้วให้เป็น Advantage ให้ลูกค้าซื้อมือถือต่อไป

ตราบใดที่มือถือแอปเปิ้ลยังดีสุดอยู่ (เขาทำดีไซน์ชิพและมือถือเก่งจริงๆ) ก็ไม่ต้องห่วงอะไรมาก คำถามคือเมื่อ AI กลายเป็นจุดที่ทำให้มือถือ (หรืออุปกรณ์ยุคใหม่ในอนาคต) แตกต่างอย่างชัดเจน แล้วแอปเปิ้ลที่ไม่มีเอไอของตัวเองจะทำอย่างไร

วงการนี้เป็นเกมของยักษ์ใหญ่

ครั้งนี้ดูเหมือนจะเป็นสงครามของยักษ์ใหญ่ เงินหนาเท่านั้น คุณ Jon เจ้าของ Blog Asianometry บอกว่าปีนี้ หน้าต่างในการทำชิพของเจ้าเล็กๆ เหมือนจะถูกปิดไปเรียบร้อยแล้ว

นั่นแปลว่าเกม AI นี้ก็เป็นอีกเกมที่จะเหลือเฉพาะผู้เล่นรายใหญ่ เงินหนา เหมือนยุคก่อน ส่วนรายเล็กก็ไปสร้าง application บน AI อีกที

Hot Chips

I visited the Bay Area to attend Hot Chips, the same reason I came last year. And as usual, I was not able to attend too many of the sessions because I flew in rather late and ended up talking to people around the show. Which I guess is better because you can just watch the sessions online anyway. Last year, the big theme was the plethora of AI accelerator teams. With Nvidia turning huge margins on its chips, startups and big companies alike were trotting out their own AI ASICs: Intel's Gaudi 3, Meta's MTIA, Furiosa's RNGD, Microsoft MAIA etc. This year, I got the sense that the window for new AI chips has closed. With the exception of Google's Ironwood TPU, which looks to be very impressive, nobody is really close to what Nvidia has.

From Asianometry article “Silicon Valley’s Doing Hard Things Again”

ทั้งหมดนี้เป็นการสังเกตุการณ์ของผม ผมพยายามจะถามตัวเองต่อว่าการที่ Landscape ชิฟมาเป็นแบบนี้ แล้วไงต่อ ใครได้ หรือเสียประโยชน์ ที่คิดออกก็คงเป็น Braodcomm ที่เป็นคนออกแบบชิพให้ Hyperscalers มั้ง แต่มุมมองนี้ก็คงสะท้อนไปในราคาหุ้น AVGO มาสักพักแล้ว

อีกอันคือ ความสำเร็จของ Amazon จะขึ้นอยู่กับความสามารถของ Anthropic มากขึ้น และความสามารถในการทำชิพสู้

แต่ถ้า AI ยัง Demand ล้น และแข่งกันในทุกแง่มุม (ทั้งประสิทธิภาพและราคา) และเปลี่ยนแปลงบ่อย แบบนี้การทำ Full stack อาจจะไม่เวิร์คผู้เล่นที่มีชิพเทพๆ จาก NVDA หรือ TPU ที่มี Headstart

👍🙏❤️